該網站上的另一張圖片顯示了一群看起來是中學生的青少年。一個男孩正在和兩個微笑著擺姿勢的女孩在看似學校體育館的地方自拍。男孩的五官被 Snapchat 鏡頭遮擋,導致他的眼睛太大,遮住了他的臉。

似乎上傳的圖像的標題表明其中包含朋友、同學和戀人的圖像。一個標題寫著“我的女朋友”,並顯示一位年輕女子對著鏡子自拍。

許多照片的主角都是 TikTok、Instagram 和其他社群媒體平台上的熱門影響者。其他照片似乎是 Instagram 截圖,人們在其中分享日常生活的圖像。其中一張圖片顯示,一位微笑的年輕女子拿著一份甜點,上面插著節慶蠟燭。

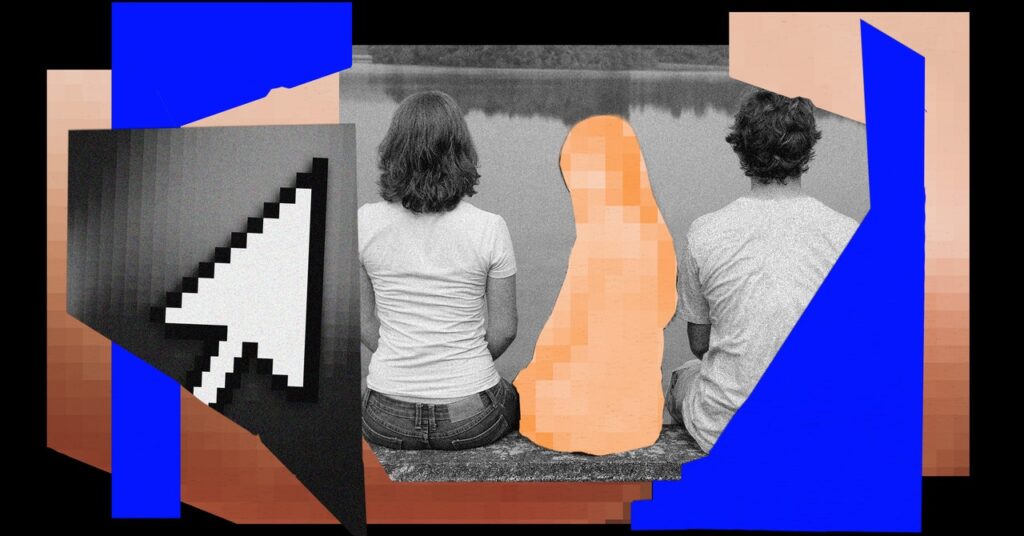

有些照片上的人與拍照者完全陌生。從後面拍攝的一張照片顯示,一名婦女或女孩只是站在似乎是旅遊景點的地方,沒有擺姿勢拍照。

《連線》雜誌審查的一些圖像中,女性和女孩的臉部被裁剪掉,只露出她們的胸部和胯部。

大量觀眾

《連線》對該網站進行了八天的監控,並在主頁中發現了五張新的女性圖像,在「探索」頁面中發現了三張新的女性圖像。根據該網站公佈的統計數據,發現這些圖片大部分都累積了數百次「瀏覽量」。目前尚不清楚提交到該網站的所有圖像是否都會發送到「主頁」或「探索」提要,或如何聚合視圖。您主頁中的每個貼文都至少有幾十個瀏覽量。

名人和擁有大量 Instagram 粉絲的人的照片在該網站“觀看次數最多”的圖像列表中名列前茅。該網站歷史上觀看次數最多的人物是演員 Jenna Ortega(觀看次數超過 66,000 次)、歌手兼作曲家 Taylor Swift(觀看次數超過 27,000 次)以及馬來西亞影響者和 DJ(觀看次數超過 26,000 次)。

史威夫特和奧特加先前曾是深度造假裸照的目標。 一月份,斯威夫特的假裸照在 X 上流傳,引發了關於深度造假的影響以及是否需要為受害者提供更強有力的法律保護的新辯論。本月,NBC 報導稱,Meta 為一款深度裸體應用程式投放了七個月的廣告。該應用程式吹噓它能夠利用 Jenna Ortega 16 歲時的照片讓人們「脫衣服」。

在美國,沒有聯邦法律涵蓋未經同意傳播假裸照的情況。有些州有自己的法律。但 NCMEC 受剝削兒童部門執行董事 Jennifer Newman 表示,人工智慧產生的未成年人裸體圖像與其他兒童性虐待材料 (CSAM) 屬於同一類別。

紐曼說:“如果它與活生生的受害者和真實兒童的圖像無法區分,那麼這對我們來說就是兒童性虐待材料。” “我們對待這些報告就好像我們正在處理它們,就像我們將它們提交給執法部門一樣。”